DeepSeek a prouvé que la formation à l'IA ne nécessite pas les GPU les plus chers comme le H100. Au contraire, les entreprises peuvent obtenir des performances élevées à moindre coût avec les GPU NVIDIA A100, V100 ou H800 remis à neuf.

IA rentable avec les GPU NVIDIA A100 et V100

L’intelligence artificielle évolue rapidement et les entreprises du monde entier cherchent des moyens de construire une infrastructure d’IA sans dépenser trop d’argent. Le succès de DeepSeek, une société chinoise d’IA, a montré que l’IA de pointe ne nécessite pas les GPU les plus récents ou les plus coûteux – il s’agit de choisir le bon matériel pour le travail à accomplir.

Par exemple, ChatGPT a été formé avec les GPU V100 et A100 de NVIDIA, tandis que DeepSeek a utilisé environ 2 000 GPU NVIDIA H800 - un modèle conçu pour la Chine qui offre une bande passante de puce à puce inférieure à celle de son homologue mondial, le H100.

Bien que l’A100 et le V100 soient des modèles de génération précédente, ils sont toujours très puissants pour l’entraînement et l’inférence de l’IA. Cela met en évidence un changement important : les entreprises peuvent obtenir de puissantes performances d’IA avec des options à faible coût comme l’A100 et le V100, plutôt que d’investir dans les derniers GPU coûteux.

Qu’est-ce que DeepSeek ?

DeepSeek est une société chinoise d’IA qui a attiré l’attention du monde entier pour avoir développé un modèle d’IA capable de rivaliser avec ChatGPT d’OpenAI, mais à un coût nettement inférieur. Contrairement aux géants américains de l’IA qui investissent des milliards dans l’infrastructure, DeepSeek affirme avoir formé son IA avec seulement 2 000 GPU NVIDIA H800, prouvant que l’IA haute performance n’a pas besoin du matériel le plus coûteux.

Cette approche positionne DeepSeek comme une alternative rentable dans le développement de l’IA et remet en question la norme de l’industrie selon laquelle l’IA de pointe nécessite des investissements financiers massifs.

À qui appartient DeepSeek ?

DeepSeek a été lancé en juillet 2023 par Liang Wenfeng, diplômé de l’Université du Zhejiang avec une expérience dans les stratégies d’investissement basées sur l’IA. Son fonds spéculatif High-Flyer l’a soutenu financièrement, et il détient une participation de 84 % dans la société par le biais de deux sociétés écrans.

L’avènement de DeepSeek représente un changement dans le développement de l’IA, montrant que les modèles d’IA peuvent être entraînés efficacement sans infrastructure d’un milliard de dollars, ce qui pourrait remodeler la façon dont les entreprises investissent dans l’IA.

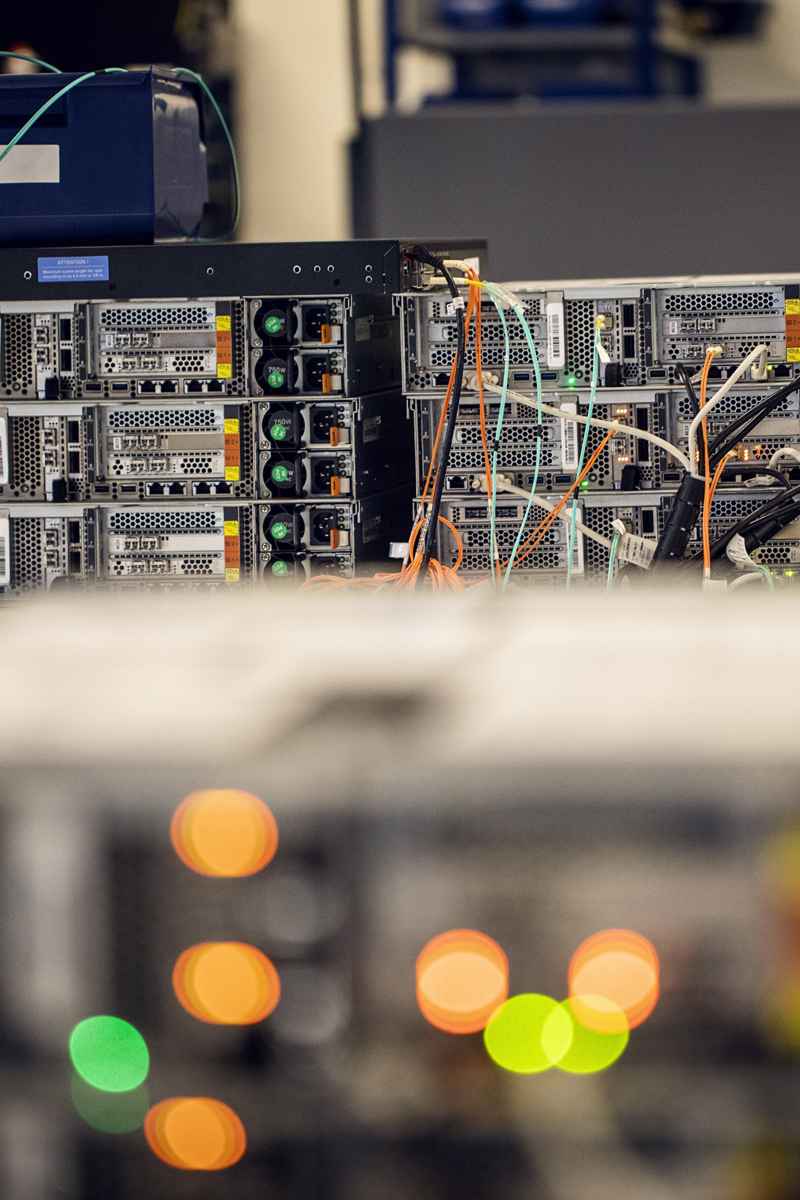

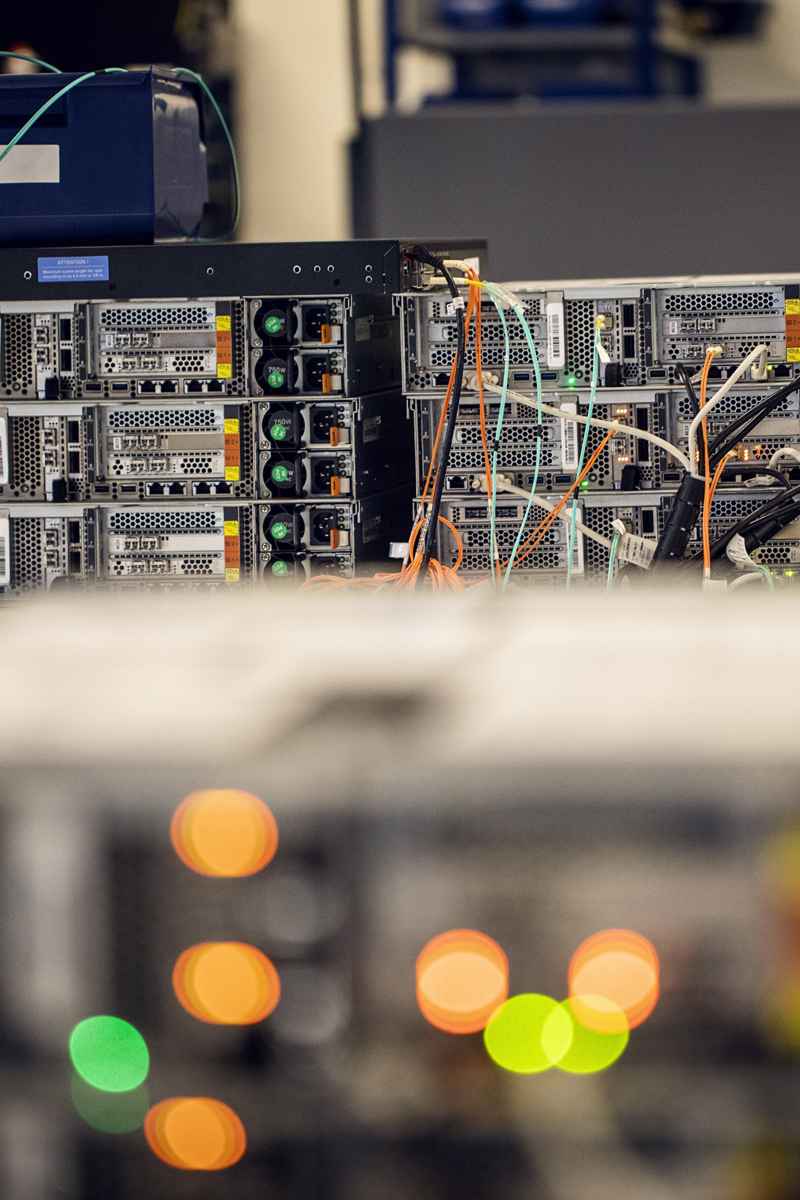

Construire des serveurs d’IA à moindre coût avec des GPU NVIDIA A100 remis à neuf

À mesure que l’adoption de l’IA se développe, les entreprises repensent leurs stratégies matérielles. Au lieu de dépenser des millions pour les derniers GPU, beaucoup choisissent des GPU NVIDIA A100 remis à neuf pour faire évoluer l’infrastructure d’IA à une fraction du coût.

En dehors de la Chine, l’A100 est la meilleure alternative au H800, offrant une puissance d’entraînement d’IA similaire avec une meilleure disponibilité mondiale. Alors que le V100 reste un choix solide pour l’inférence, l’A100 offre une efficacité, une évolutivité et une bande passante mémoire améliorées pour les applications d’IA modernes.

H100 est l’option la plus puissante, mais A100 offre le meilleur équilibre entre coût et performance pour les entreprises qui optimisent leurs investissements dans l’IA.

Pourquoi choisir les GPU A100 remis à neuf ?

✔ Jusqu’à 70 % d’économies – Performances de l’IA d’entreprise à moindre coût

✔ Durable et efficace – Prolongez la durée de vie du GPU et réduisez les dépenses

✔ informatiques Optimisé pour l’IA – Idéal pour l’apprentissage profond et les grands modèles de langage (LLM)

Coûts réduits, performances maximales

Le coût élevé du nouveau matériel limite l’adoption de l’IA, mais les GPU A100 remis à neuf offrent une puissance de traitement massive pour l’apprentissage en profondeur, l’entraînement de modèles et les applications d’IA en temps réel, aidant ainsi les entreprises à rester compétitives.

Au-delà des économies de coûts, les GPU remis à neuf libèrent du capital pour la recherche sur l’IA, l’optimisation des données et le développement de logiciels, accélérant ainsi l’innovation tout en conservant une flexibilité financière.

Le NVIDIA H100 est de loin le GPU le plus puissant pour les charges de travail d’IA, mais son coût est nettement plus élevé. L’A100, quant à lui, offre le meilleur rapport qualité-prix, ce qui le rend idéal pour les entreprises qui ont besoin d’une formation à l’IA à grande vitesse sans le coût d’une mise à niveau du H100.

Comment le NVIDIA A100 se compare-t-il au H800 ?

Le H800 est une variante spécifique à la Chine du H100, construite avec une bande passante NVLink réduite et des performances globales inférieures en raison des restrictions à l’exportation des États-Unis. Bien que H800 offre de solides capacités d’IA, les entreprises en dehors de la Chine ne peuvent pas y accéder et ont besoin d’une alternative.

Pour les entreprises en dehors de la Chine, l’A100 est la meilleure alternative au H800, offrant de solides performances et une efficacité d’IA. Cependant, le H100 reste le premier choix pour ceux qui nécessitent le plus haut niveau de puissance de calcul d’IA.

| Spécification | NVIDIA H100 | NVIDIA H800 | NVIDIA A100 |

|---|---|---|---|

| Architecture | Hopper | Hopper | Ampere |

| Technologie de fabrication | 4nm TSMC | 4nm TSMC | 7nm TSMC |

| Mémoire GPU | 80GB HBM3 | 80GB HBM3 | 40GB/80GB HBM2e |

| Bande passante mémoire | Jusqu'à 3,35 To/s (SXM) | ~1.9 TB/s (SXM) | Jusqu'à 2,0 To/s (version 80GB) |

| Bande passante NVLink | 900 GB/s | 400 GB/s | 600 GB/s |

| Génération PCIe | PCIe 5.0 | PCIe 4.0 | PCIe 4.0 |

| Performance | Meilleure performance pour l'entraînement et l'inférence en IA | Performance réduite en raison d'une bande passante NVLink inférieure | Excellente performance pour l'entraînement IA et le HPC |

| Disponibilité sur le marché | Mondiale (IA d'entreprise, HPC) | Limitée à la Chine | Mondiale |

| Meilleur cas d'utilisation | Modèles IA de grande taille, entraînement LLM, IA haute performance | IA rentable pour les entreprises chinoises | Entraînement IA, deep learning, charges de travail HPC |

Économisez jusqu'à 70 % en achetant un GPU NVIDIA A100 reconditionné chez Renewtech.

Le GPU NVIDIA A100 Tensor Core est conçu pour l'entraînement en IA, le deep learning et l'inférence. Il offre des performances à large bande passante pour les charges de travail IA exigeantes, à une fraction du coût des modèles plus récents.

Serveurs IA prenant en charge NVIDIA A100

Le choix du bon serveur d’IA est essentiel pour l’évolutivité, l’efficacité et la rentabilité. Les charges de travail d’IA, telles que le deep learning, les grands modèles de langage (LLM) et l’inférence en temps réel, nécessitent un matériel puissant pour maximiser les performances sans coûts inutiles.

Pour les entreprises qui cherchent à faire évoluer l’IA à un prix abordable, les GPU NVIDIA A100 remis à neuf offrent une puissance de calcul élevée à une fraction du coût. Pour simplifier votre décision, nous avons sélectionné deux serveurs d’IA hautes performances qui prennent entièrement en charge les GPU NVIDIA A100, offrant le bon équilibre entre vitesse, fiabilité et rentabilité.

Pourquoi il est important de choisir le bon serveur d’IA :

- Charges de travail optimisées : l’entraînement, l’inférence et l’apprentissage profond de l’IA nécessitent des GPU hautes performances, de la mémoire et de la bande passante PCIe pour un fonctionnement fluide.

- Évolutivité et pérennité – Un serveur bien choisi garantit une expansion en douceur à mesure que les demandes d’IA augmentent.

- Rentabilité – Investir dans le bon matériel maximise le retour sur investissement et minimise le gaspillage de ressources.

Avec les serveurs d’IA alimentés par NVIDIA A100, les entreprises peuvent créer une infrastructure d’IA qui offre des performances solides tout en respectant leur budget.

Supermicro SYS-4028GR-TRT par rapport au Dell PowerEdge R740 pour l’IA

Le choix du bon serveur d’IA est essentiel pour maximiser les performances et l’efficacité. Le Supermicro SYS-4028GR-TRT et le Dell PowerEdge R740 prennent tous deux en charge les GPU NVIDIA A100, mais ils prennent en charge des charges de travail d’IA différentes.

- Le Supermicro SYS-4028GR-TRT est conçu pour l’apprentissage profond à grande échelle, prenant en charge jusqu’à 4 GPU NVIDIA A100, ce qui en fait le meilleur choix pour les entreprises ayant besoin d’une densité de GPU élevée.

- Le Dell PowerEdge R740, en revanche, prend en charge jusqu’à 2 GPU A100, ce qui en fait une alternative rentable pour les entreprises qui se concentrent sur l’inférence d’IA et la formation à plus petite échelle.

Vous trouverez ci-dessous une comparaison côte à côte pour vous aider à décider quel serveur d’IA correspond le mieux aux besoins de votre infrastructure GPU.

| Caractéristique | Supermicro SYS-4028GR-TRT | Dell PowerEdge R740 |

| Support GPU | Jusqu'à 4x NVIDIA A100 PCIe – Optimisé pour les charges de travail IA multi-GPU. | Jusqu'à 2x NVIDIA A100 PCIe – Conçu pour l’accélération de l'IA avec une efficacité économique. |

| Options CPU | Intel Xeon Scalable (2ᵉ génération) – Support bi-socket pour une IA haute performance. | Intel Xeon Scalable (2ᵉ génération) – Bien équilibré pour les charges de travail d’inférence. |

| Capacité mémoire | Jusqu'à 6 To DDR4 – Conçu pour les modèles IA à grande échelle et le deep learning. | Jusqu'à 3 To DDR4 – Prend en charge les charges de travail IA, mais avec une évolutivité moindre. |

| Capacités de stockage | Prend en charge jusqu'à 24 disques 2,5” (HDD/SSD) – Conçu pour l'entraînement IA à forte intensité de données. | Prend en charge jusqu'à 16 disques 2,5” (HDD/SSD) – Suffisant pour les applications d’inférence. |

| Réseau et connectivité | Plusieurs options 10GbE et 25GbE, PCIe 4.0 pour un flux de données IA à large bande passante. | Ports doubles 10GbE, PCIe 4.0, adapté à une efficacité optimale pour l'inférence IA. |

| Extension et évolutivité | Plus de slots PCIe Gen 4 – Idéal pour les configurations multi-GPU et les extensions futures. | Bon support PCIe 4.0 – Adapté aux charges IA, mais évolutivité multi-GPU limitée. |

| Refroidissement et alimentation | Optimisé pour les GPU haute densité – Refroidissement avancé pour gérer efficacement plusieurs A100. | Gestion thermique efficace – Refroidissement écoénergétique pour les charges d'inférence. |

| Facteur de forme et densité | Serveur rack 4U – Plus grande densité, conçu pour l'entraînement de modèles IA à grande échelle. | Serveur rack 2U – Optimisé pour un gain d’espace avec des capacités modérées d’accélération IA. |

| Cas d'utilisation | Entraînement de modèles IA, deep learning et LLM – Idéal pour la recherche et la production IA. | Inférence IA, déploiements IA économiques – Optimisé pour les entreprises axées sur l’IA cherchant à évoluer avec un bon rapport coût-efficacité. |

Supermicro SYS-4028GR-TRT

Serveur d’IA haute densité conçu pour l’informatique multi-GPU, le Supermicro SYS-4028GR-TRT est conçu pour maximiser les performances de la NVIDIA A100. Avec de nombreuses voies PCIe 4.0, une efficacité énergétique robuste et un refroidissement supérieur, il garantit des charges de travail stables d’entraînement et d’inférence de l’IA.

- Optimisé pour l’IA et l’apprentissage automatique – Prend en charge les configurations multi-GPU, ce qui le rend idéal pour l’apprentissage profond et les grands modèles d’IA.

- Performances de niveau entreprise – Bande passante élevée et efficacité de refroidissement pour gérer des calculs d’IA intensifs.

Libérez les performances de l’IA avec le Supermicro SYS-4028GR-TRT

Dell PowerEdge R740

Serveur d’entreprise polyvalent, le Dell PowerEdge R740 offre une solution évolutive pour les charges applicatives d’IA et de HPC. Prenant en charge plusieurs GPU NVIDIA A100, il offre une capacité de mémoire élevée, un refroidissement efficace et de solides performances PCIe 4.0.

- Infrastructure d’IA évolutive – Configurable pour l’entraînement de modèles d’IA, l’inférence et le calcul haute performance.

- Performances rentables – Un R740 remis à neuf permet aux entreprises d’intégrer l’IA sans dépenses excessives, ce qui permet de maintenir des performances élevées tout en réduisant les coûts.

Libérez les performances de l’IA avec le PowerEdge R740

Maximiser les performances de l’IA avec les serveurs H100

Pour les entreprises qui ont besoin de plus de puissance de calcul pour des applications d’IA de pointe, la mise à niveau vers les GPU NVIDIA H100 offre l’un des plus hauts niveaux de performances d’IA disponibles. Que vous travailliez sur l’apprentissage profond à grande échelle, la formation LLM ou l’inférence d’IA en temps réel, il est essentiel de disposer de la bonne infrastructure de serveur.

Contrairement aux générations précédentes de GPU, les GPU H100 offrent :

- Accélération inégalée de l’IA – Opérations matricielles plus rapides, bande passante NVLink accrue et efficacité de la mémoire accrue.

- Évolutivité à l’épreuve du temps – Optimisé pour la formation à l’IA, le HPC et les charges de travail d’entreprise avec prise en charge PCIe 5.0.

Les entreprises qui gèrent des ensembles de données d’IA massifs, des simulations à grande échelle ou des ajustements de modèles avancés bénéficieront le plus du déploiement de serveurs d’IA prêts pour H100. Ces serveurs sont conçus pour gérer des charges de travail d’IA à large bande passante, garantissant des temps d’entraînement plus rapides, une inférence en temps réel et une évolutivité transparente pour les futurs projets d’IA.

Avec des serveurs d’IA remis à neuf, les entreprises peuvent intégrer des GPU H100 à moindre coût, évitant ainsi les dépenses d’infrastructure inutiles tout en bénéficiant de performances d’IA de premier ordre.

Dell R750 et Lenovo SR650 V2 pour l’IA

Choisir le bon serveur pour l’IA et l’apprentissage profond est crucial pour maximiser les performances et l’efficacité. Le Dell PowerEdge R750 et le Lenovo ThinkSystem SR650 V2 prennent tous deux en charge les GPU NVIDIA H100, mais ils répondent à des besoins légèrement différents. Le R750 offre plus d’emplacements PCIe pour une meilleure extension, tandis que le SR650 V2 se concentre sur l’évolutivité et la rentabilité. Vous trouverez ci-dessous une comparaison côte à côte pour vous aider à décider lequel convient le mieux à votre infrastructure d’IA.

| Caractéristique | Dell PowerEdge R750 | Lenovo ThinkSystem SR650 V2 |

| Support GPU | Jusqu'à 2x NVIDIA H100 PCIe | Jusqu'à 2x NVIDIA H100 PCIe |

| Options CPU | Intel Xeon Scalable (3ᵉ génération) | Intel Xeon Scalable (3ᵉ génération) |

| Capacité mémoire | Prend en charge jusqu'à 8 To DDR4/DDR5 | Prend en charge jusqu'à 8 To DDR4/DDR5 |

| Capacités de stockage | Prend en charge jusqu'à 28 disques 2,5” (HDD/SSD) | Prend en charge jusqu'à 20 disques 2,5” (HDD/SSD) |

| Réseau et connectivité | Ports doubles 10GbE, slots PCIe Gen 5 pour une compatibilité future | Ports doubles 10GbE, PCIe Gen 4, haute efficacité énergétique |

| Extension et évolutivité | Plus de slots PCIe Gen 4/5 – Idéal pour les configurations multi-GPU et les accélérateurs IA comme NVIDIA NVLink Bridges. | Conception écoénergétique avec refroidissement Lenovo Neptune™ – Axé sur la réduction des coûts tout en maintenant les performances IA. |

| Refroidissement et alimentation | Optimisé pour les charges IA gourmandes en énergie – Intègre Dell Smart Cooling pour les GPU haute performance comme le H100. | Gestion efficace du refroidissement et de l’alimentation – Utilise Lenovo XClarity Controller pour équilibrer la consommation d'énergie dans les applications IA. |

| Facteur de forme et densité | Serveur rack 2U – Densité plus élevée pour l'IA d'entreprise | Serveur rack 2U – Conçu pour la scalabilité et l’expansion modulaire de l’IA |

| Cas d'utilisation | IA d'entreprise et calcul haute performance | Infrastructure IA évolutive et déploiement IA économique |

Dell PowerEdge R750

Serveur d’entreprise hautes performances conçu pour l’accélération de l’IA, le PowerEdge R750 prend en charge jusqu’à deux GPU PCIe NVIDIA H100. Avec des voies PCIe Gen 4 et un réseau à haut débit, il fournit la puissance nécessaire à l’entraînement de modèles d’IA, à l’inférence et aux applications gourmandes en données.

- Optimisé pour l’IA et l’apprentissage automatique – Prend en charge les configurations à double GPU, accélérant les charges de travail d’IA et l’inférence en temps réel.

- Performances de niveau entreprise – Fournit une bande passante élevée et une gestion efficace de l’alimentation, ce qui en fait un choix idéal pour les entreprises et les entreprises axées sur l’IA.

Libérez les performances de l’IA avec le PowerEdge R750

Lenovo ThinkSystem SR650 V2

Ce serveur rack polyvalent est conçu pour les entreprises qui ont besoin d’évolutivité. Prenant en charge les GPU pleine longueur, pleine hauteur et double largeur, y compris le NVIDIA H100, il est optimisé pour les charges de travail d’IA nécessitant un traitement rapide, l’apprentissage en profondeur et l’analyse du Big Data.

- Infrastructure d’IA prête pour l’avenir – Conçue pour des déploiements d’IA évolutifs, garantissant une expansion en douceur à mesure que les demandes d’IA augmentent.

- Performances rentables – Un SR650 V2 remis à neuf permet aux entreprises d’intégrer une infrastructure d’IA à un coût nettement inférieur, ce qui rend l’IA haute performance plus accessible.

Libérez les performances de l’IA avec le SR650 V2

Besoin d’aide pour choisir le bon serveur d’IA ?

Choisir le bon serveur d’IA ne doit pas être difficile. Que vous ayez besoin de GPU NVIDIA A100 ou H100 remis à neuf ou de recommandations d’experts, nous sommes là pour vous aider.

Comment nous pouvons vous aider :

✔ Guidage personnalisé du serveur d’IA – Trouvez la solution la mieux adaptée à vos besoins en matière d’entraînement de modèles d’IA ou d’apprentissage en profondeur. ✔ Alertes de stock et de disponibilité – Soyez averti lorsque les GPU A100 ou H100 remis à neuf sont de nouveau en stock ou découvrez des solutions alternatives.